AI智能体OpenClaw爆火一周后反转,安全隐患引发卸载潮;企业需警惕影子资产入侵。

近期,一款名为OpenClaw的开源AI智能体迅速走红,其标志性龙虾形象让无数用户沉迷于“养虾”乐趣中。这款工具能自主执行任务,从清理邮件到管理日程,极大提升了日常效率。然而,好景不长,仅一周时间,热情迅速冷却,大量用户开始紧急寻求卸载服务。一些人报告称,授权后出现意外操作,导致重要数据丢失或隐私暴露。这种从狂热追捧到集体退潮的现象,揭示出AI从单纯对话向实际行动转变时潜藏的深刻挑战。

用户经历显示,部分早期尝试者遭遇了各种问题。例如,有人允许OpenClaw访问邮箱,结果重要邮件被意外批量处理;另一些人委托它优化存储空间,却发现关键文件夹被误删。更严重的情况涉及密钥管理不当,导致资产遭受损失。这些真实案例并非孤立,而是反映出当AI具备系统操作能力后,任何配置失误都可能放大为实际损害。OpenClaw的快速流行加速了这一过程,也让人们开始认真审视这类工具的边界。

与传统AI不同,OpenClaw这类智能体拥有访问真实资源、调用外部工具以及自主规划路径的核心特征。这些能力让它从辅助角色跃升为执行者,但同时也引入了全新的安全维度。一旦出现漏洞或误操作,影响将直接触及用户设备、数据乃至业务流程。OpenClaw的经历成为典型警示:技术便利性与潜在风险往往并存,需要用户在兴奋之余保持理性判断。

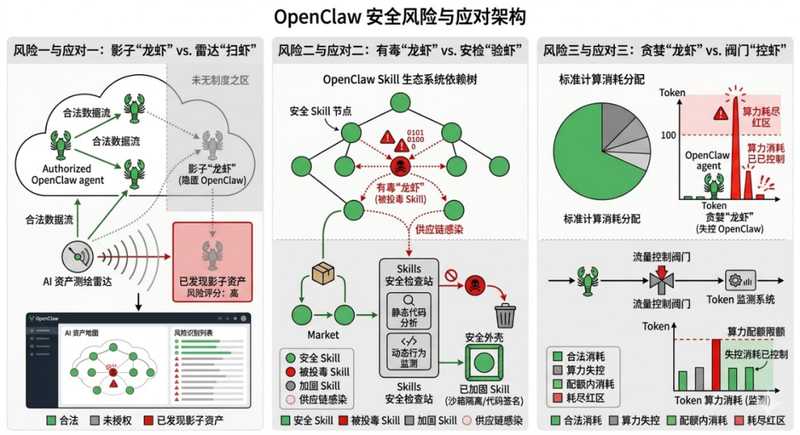

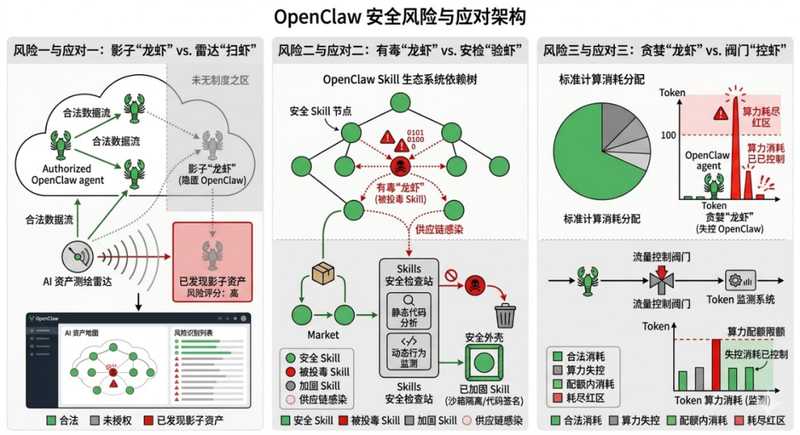

针对这类风险,专业安全方案开始浮出水面。一些工具专注于资产测绘,通过网络扫描和指纹识别技术,自动探测隐藏的AI系统。这些方法能覆盖各种形态的智能体部署,帮助企业或个人及时掌握环境中的潜在盲点。同时,对已发现资产进行组件分析,识别框架漏洞、插件缺陷以及工具调用中的薄弱环节,提供针对性修复指导。这种主动发现机制显著降低了“看不见”的管理难题。

此外,构建风险画像成为另一关键步骤。通过整合多源数据,对每个AI资产评估暴露程度、关联问题以及潜在影响,形成清晰优先级排序。高风险节点得以优先处理,避免资源浪费。供应链分析也在其中发挥作用,考察组件来源的可靠性,防范隐蔽投毒可能。综合这些能力,OpenClaw等工具的使用环境逐步趋向可控,为AI技术在实际场景中的安全应用提供支撑。长远来看,只有平衡创新与防护,才能让这类智能体真正惠及用户而非制造麻烦。

总体而言,OpenClaw的冰火一周不仅是技术热潮的缩影,更是AI治理议题的警钟。用户应审慎授权,优先选择官方渠道并加强权限控制;企业则需建立动态监测机制,及时纳入影子资产管理范畴。随着类似工具持续演进,安全实践也将不断迭代,最终推动整个生态向更成熟方向发展。